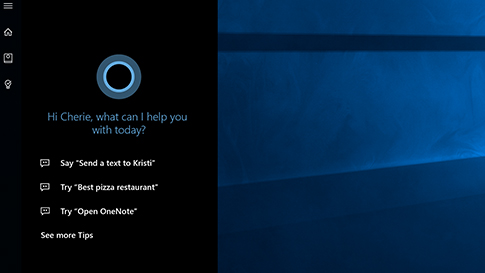

Cortana, intelligenza artificiale di casa Microsoft con un nome preso in prestito da un personaggio del videogame Halo, cosa succede quando “le” si chiede di cimentarsi in una missione al limite?

Appena cinque anni fa nasceva Cortana, l’assistente digitale di casa Microsoft, programmata sapientemente per rispondere celermente alle richieste di utenti sempre più esigenti, oggi è una chiacchierona, possiede una mente arguta, un umorismo sottile e una naturale predisposizione ad aiutare gli utenti.

Ciò che caratterizza maggiormente questa intelligenza artificiale altamente evoluta è la sua spiccata umanità. Daniela è una content editor e copywriter che gli amici chiamano scherzosamente Cortana. Lei è una delle persone che si cela dietro la versione italiana dell’assistente digitale di Microsoft, fa parte del Cortana International Team e insieme ai suoi colleghi, provenienti da tutto il mondo, lavora sulla personalità dell’intelligenza artificiale di Microsoft e sulle sue abilità di conversazione.

In pratica realizza contenuti editoriali creativi e fa in modo che le persone si divertano a parlare con lei. Il suo compito è anche quello di alimentare costantemente l’intelligenza di Cortana attraverso un aggiornamento continuo, che le permetta di conversare con l’utente coerentemente con la propria personalità. Una personalità composta da quattro qualità fondamentali: disponibilità, imparzialità, atteggiamento positivo e spontaneità.

È di fondamentale importanza sottolineare che anche la cultura locale influisce molto sulla personalità di Cortana. La versione inglese, ad esempio, non può assolutamente coincidere con quella italiana. Sotto questo punto di vista Cortana è in linea con lo spirito regionale, conosce infatti numerosi dialetti e ha un solido background relativo a usi, costumi. Conosce l’inno di Mameli e tifa per la nazionale di calcio italiana, anche quando questa non arriva ai mondiali.

Ma come conciliare una programmazione efficiente senza contraddizioni logiche con il comportamento “umano” di un tifoso di calcio sempre positivo, disponibile e spontaneo? In poche parole, cosa succede quando la mente umana si nasconde dietro l’intelligenza artificiale?

Qualche comportamento “strano” in passato (ora “patchato”) è già emerso, facendo le “domande giuste” all’assistente vocale di Windows era possibile aprire un sito infetto sul browser anche senza autenticarsi con password.

Come spiegano i ricercatori di McAfee, che hanno escogitato la tecnica di attacco, il problema era legato al fatto che l’assistente vocale di Windows rimaneva attivo anche quando il computer veniva bloccato, ed era possibile utilizzarlo anche senza autenticarsi con password o PIN. Lo scenario divenne ancor più preoccupante quando fu dimostrata la possibilità di utilizzare una “pennetta” USB per sbloccare il pc. Questa serie di combinazioni potrebbero potenzialmente permettere un proliferare di attacchi hacker verso i computer che sono tutti collegati tra loro.

Gli uomini, di fatto, stanno attaccando i sistemi di Intelligenza Artificiale e non viceversa, come invece ci saremmo aspettati dai film di fantascienza.

Ma per fare che cosa? Per manipolare i risultati dei motori di ricerca, modificare gli algoritmi dei social media, il ranking e la reputazione dei siti web, disturbare il volo dei droni o ingannare una macchina a guida autonoma.

E così, al contrario di quello che speravamo, l’uso malevolo degli strumenti di intelligenza artificiale non si è fermato alla creazione di sofisticate campagne di disinformazione.

L’allarme viene da un rapporto del progetto europeo Sherpa, dedicato a diritti umani e intelligenza artificiale, e che ha evidenziato come singoli criminali e hacker organizzati abbiano trovato un nuovo obbiettivo nell’attaccare i sistemi “intelligenti”, fino ai casi in cui la governance algoritmica può dare priorità a interessi nascosti, danneggiare aziende manipolando dati e informazioni online o beneficiare partiti di governo influenzando il dibattito politico attraverso le fake news.

Ma quale è lo stato dell’arte delle IA?

Pochi giorni fa un sistema avanzato di IA ha superato un test di scienze di terza media, rispondendo correttamente al 90 per cento delle domande. Il risultato è stato ottenuto da Aristo, una AI realizzata dall’Allen Institute for Artificial Intelligence negli Stati Uniti, dimostrando ancora una volta i rapidi progressi nel settore delle intelligenze artificiali. Centinaia di istituti di ricerca in giro per il mondo lavorano a sistemi come Aristo e, in poco tempo, hanno ottenuto risultati che solo dieci anni fa sembravano irraggiungibili. La maggiore potenza di calcolo dei computer e l’affinamento dei sistemi di catalogazione e apprendimento dei dati hanno permesso di compiere grandi progressi, riducendo i tempi di programmazione.

E mentre siamo un po' tutti preoccupati per “l’avvento della Singolarità”, il momento in cui secondo studiosi come Ray Kurzweil l’intelligenza artificiale eguaglierà l’intelligenza umana, non ci rendiamo conto che le tecniche basilari che adesso emulano soltanto alcune funzioni cognitive umane, vengono usate per scopi dannosi, ogni giorno, sono capaci di mettere in crisi tutti quei sistemi che usiamo contro le intrusioni informatiche, le diagnosi mediche, i livelli di approvvigionamento idrico, fino ai sistemi antifrode delle banche.

Spiega Andy Patel, ricercatore del centro di eccellenza per l'intelligenza artificiale di F-Secure, partner del progetto Sherpa: "Le persone identificano erroneamente l'intelligenza artificiale con quella umana, e penso che sia per questo che associano la minaccia dell'IA ai robot killer e ai computer fuori controllo. Ma gli attacchi umani contro l'IA avvengono in continuazione." Un esempio popolare di questo attacco è la manipolazione del posizionamento nei motori di ricerca o dei sistemi di reputazione per promuovere o 'nascondere' determinati contenuti a pagamento oppure no. Questi attacchi possono però anche essere usati per il social engineering di individui in scenari di attacco mirati a decisori pubblici.

Il rapporto Sherpa rileva che le tecniche di intelligenza artificiale sono utilizzate per produrre contenuti scritti, audio e visivi estremamente realistici. È il caso dei deep fake video, clip completamente false, grazie alle quali è possibile, a partire da una ripresa televisiva, mimare il labiale di un parlante per fargli dire cose che non si sognerebbe mai. Che uso se ne può fare? Ad esempio per manipolare delle prove, creare una crisi diplomatica, raggirare un concorrente. Gli usi malevoli dell’intelligenza artificiale sono già tra noi senza doverci immaginare un killer come quello del film Terminator. Per questo i ricercatori suggeriscono di progettare sistemi intelligenti e sicuri, da subito.

I programmatori Microsoft hanno da tempo compreso le potenzialità di un attacco che sfrutta i sistemi di intelligenza artificiale che come ogni buon assistente ha la naturale “propensione ad aiutarci”, difatti hanno provveduto nel tempo a limitarne le capacità di azione e ad acquisire ulteriori expertise anche dalla “concorrenza”, non è passata inosservata l’assunzione dell’ex vice presidente Apple Bill Stasior, operazione passata agli onori della stampa come da Siri a Cortana. Questo dimostra che si sta finalmente prendendo seriamente in considerazione il fatto che dare il pieno controllo di un sistema, ad un’intelligenza artificiale non è sinonimo di sicurezza.

A tutt’oggi non è necessario essere un hacker esperto per violare un sistema ed ottenere delle informazioni o guadagnare accessi illeciti, basta conoscere la natura umana che si cela dietro la fredda logica della programmazione e saper porre la domanda giusta.

Fonte, link e riferimenti: http://www.difesaonline.it